Llamafirewall est un cadre de sécurité au niveau du système pour les applications alimentées par LLM, construites avec une conception modulaire pour prendre en charge la défense adaptative en couches. Il est conçu pour atténuer un large éventail de risques de sécurité des agents d’IA, notamment le jailbreaking et l’injection rapide indirecte, le détournement d’objectifs et les sorties de code sans sécurité.

Pourquoi Meta a créé Llamafirewall

Les LLM se déplacent bien au-delà des simples cas d’utilisation du chatbot et deviennent les composants centraux des systèmes autonomes à haute confiance. Avec cette sophistication croissante, une augmentation correspondante des risques de sécurité. «Les LLM ont progressé au point où ils peuvent fonctionner comme des agents autonomes, mais les mesures de sécurité existantes n’ont jamais été conçues avec ce niveau de capacité à l’esprit», a déclaré à Help Net Security Sahana Chennabasappa, ingénieur de sécurité chez Meta, à Help Net Security. Cette déconnexion crée des angles morts dangereux dans la façon dont les organisations sécurisent ces systèmes.

Une zone particulièrement concernant est l’utilisation de LLMS dans les applications de codage. «Les agents de codage qui reposent sur le code généré par LLM peuvent introduire par inadvertance des vulnérabilités de sécurité dans les systèmes de production», a averti Chennabasappa. «Le raisonnement en plusieurs étapes mal aligné peut également amener les agents à effectuer des opérations qui s’éloignent bien au-delà de l’intention d’origine de l’utilisateur.» Ces types de risques font déjà surface dans des copilotes codants et des agents de recherche autonomes, a-t-elle ajouté, et ne devrait que se développer à mesure que les systèmes agents deviennent plus courants.

Pourtant, alors que les LLM sont intégrées plus profondément dans les flux de travail critiques, l’infrastructure de sécurité environnante n’a pas suivi le rythme. “L’infrastructure de sécurité pour les systèmes basés sur LLM en est encore à ses balbutiements”, a déclaré Chennabasappa. “Jusqu’à présent, l’objectif de l’industrie a été principalement limité aux garde-corps de modération de contenu destinés à empêcher les chatbots de générer une mauvaise information ou un contenu abusif.”

Cette approche, a-t-elle soutenu, est beaucoup trop étroite. Il surplombe les menaces plus profondes et plus systémiques comme l’injection rapide, la génération de code sans sécurité et les capacités d’interprète de code. Même les systèmes de sécurité propriétaires que les règles du code dur dans les API d’inférence du modèle sont insuffisants, selon Chennabasappa, car ils n’ont pas la transparence, l’auditabilité et la flexibilité nécessaires pour garantir des applications d’IA de plus en plus complexes.

En réponse, Chennabasappa et son équipe ont développé Llamafirewall, une nouvelle architecture de sécurité au niveau du système conçu spécifiquement pour les agents basés sur LLM. “Llamafirewall orchestre les défenses en tandem avec des garde-corps pour lutter contre les menaces émergentes que les garanties traditionnelles centrées sur le chatbot n’étaient tout simplement pas conçues pour gérer”, a-t-elle expliqué.

Ce qui rend LlaMafirewall unique

Llamafirewall est un cadre de sécurité au niveau du système pour les applications alimentées par LLM, construites avec une conception modulaire pour prendre en charge la défense adaptative en couches. Il est conçu pour atténuer un large éventail de risques de sécurité des agents d’IA, notamment le jailbreaking et l’injection rapide indirecte, le détournement d’objectifs et les sorties de code sans sécurité.

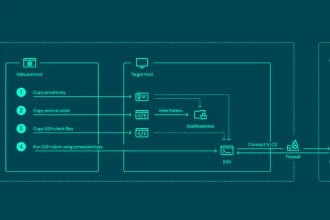

Chennabasappa explique que Llamafirewall comprend trois garde-corps adaptés aux besoins des flux de travail de l’agent LLM qui se transforment en deux catégories: injection rapide / désalignement des agents et code peu sûr / dangereux. Les trois garde-corps comprennent:

1. Promptguard 2un détecteur de jailbreak universel qui détecte des tentatives directes de jailbreak avec une grande précision et une faible latence et fonctionne en temps réel sur les sources de données invitées et non fiables.

2. Vérification de l’alignement des agentsun auditeur de la chaîne de pensées qui inspecte le raisonnement des agents pour une injection rapide et un désalignement des objectifs (il s’agit de la première garde-corps open source à auditer une chaîne de pensée LLM en temps réel destiné à la défense par injection pour s’assurer que les plans d’un agent d’IA n’ont pas été détournés par une contribution adversaire.)

3. CodeShieldun moteur d’analyse statique en ligne à faible latence qui détecte les sorties de code sans sécurité des LLM, sauvegarde contre les vulnérabilités potentielles. Nous avons précédemment publié CodeShield dans le cadre du lancement de LLAMA 3, et l’incluons maintenant dans ce cadre unifié. Parallèlement à tous ces scanners intégrés, Llamafirewall fournit également des vérifications basées sur Regex et LLM personnalisables qui peuvent être configurées en fonction du modèle de menace d’application spécifique et du cas d’utilisation.

“LlamaFirewall incorporates these guardrails into a unified policy engine. With LlamaFirewall, developers can construct custom pipelines, define conditional remediation strategies, and plug in new detectors. Like Snort, Zeek, or Sigma in traditional cybersecurity, LlamaFirewall aims to provide a collaborative security foundation—one where researchers, developers, and operators can share policies, compose defenses, and adapt to new Menaces en temps réel », a déclaré Chennabasappa.

Llamafirewall est conçu avec la flexibilité à l’esprit, ce qui lui permet de travailler sur une large gamme de systèmes d’IA, quel que soit le cadre agentique sous-jacent. “Il peut être utilisé avec n’importe quel système d’IA, ouvert ou fermé, qui permet aux développeurs d’incorporer des mécanismes de sécurité supplémentaires”, a déclaré Chennabasappa, mettant l’accent sur la large applicabilité de l’outil.

Positionné comme une solution open source axée sur la sécurité, Llamafirewall adopte une approche de défense en profondeur en couches. Selon Chennabasappa, cette stratégie «s’appuie sur la vaste expérience de Meta dans les systèmes à grande échelle et les environnements de production pour assurer le développement sécurisé des applications et des agents de l’IA».

Contrairement aux outils propriétaires qui peuvent limiter la visibilité et la personnalisation, Llamafirewall adopte l’ouverture. «Sa nature open source fournit une plate-forme transparente et extensible pour les plugins, les règles et les détecteurs construits par la communauté», a noté Chennabasappa, soulignant comment cette transparence soutient une plus grande confiance et adaptabilité dans les pratiques de sécurité de l’IA.

Plans et téléchargements futurs

Alors que LlamaFirewall se concentre actuellement sur l’injection rapide et la génération de code insécurité, les développeurs voient le potentiel d’élargir sa portée pour englober d’autres comportements à haut risque tels que l’exécution de code malveillant et l’utilisation des outils dangereuse pour permettre une protection plus complète tout au long du cycle de vie de l’agent.

Llamafirewall est disponible gratuitement sur Github.

![]()

Doit lire:

![]()

Abonnez-vous à la newsletter mensuelle de Help Net Security Ad-Free pour rester informé des outils essentiels de cybersécurité open source. Abonnez-vous ici!

![]()